آموزش پیشپردازش داده با پایتون: صفر تا صد پاکسازی و آمادهسازی دیتا

فهرست مطالب این نوشته

Toggleدر دنیای امروز، دادهها سوخت موتورهای هوش مصنوعی، یادگیری ماشین و تحلیلهای کسبوکار هستند. اما این سوخت تا زمانی که ساختارمند و استاندارد نباشد، خروجی قابلاعتمادی تولید نمیکند.

پیشپردازش داده با پایتون همان فرایندی است که دادهها را از حالت خام، نامنظم و پر از خطا به دیتای تمیز، قابل استفاده و آمادهی تحلیل تبدیل میکند. در این مطلب قصد داریم از صفر تا صد آموزش پیشپردازش داده با پایتون و پاکسازی داده با پایتون را بررسی کنیم.

تخفیفهای شگفتانگیز جشنواره آکادمی چابک

تخفیف بگیر و ثبت نام کن!

پیشپردازش داده یعنی چه؟

پیشپردازش داده یعنی پاکسازی، تبدیل، یکپارچهسازی و آمادهسازی دیتا. فرایندی که دادههای خام را به فرمت قابل استفاده برای تحلیل و مدلسازی تبدیل میکند. در پیشپردازش داده با پایتون هدف این است که نویزها حذف شوند، مقادیر گمشده مدیریت شوند، دادهها استاندارد شوند و ویژگیهای قابل فهم برای مدل ایجاد شود. بدین ترتیب میتوانیم دیتایی بهینهشده و قابل اتکا برای الگوریتمهای یادگیری ماشین و تحلیلهای آماری خود داشته باشیم.

چرا باید دیتا را پیشپردازش کنیم؟

در آموزش Data Preprocessing در پایتون همیشه بر اهمیت مرحله پیشپردازش تأکید میشود، زیرا دادههای بیکیفیت مساوی است با خروجی اشتباه.

باید بدانید که مدلها نسبت به خطا، نویز و مقادیر گمشده حساساند و پیشپردازش میتواند این مشکلات را کنترل، اصلاح یا حذف کند. بدین ترتیب تحلیلگر یا تیم بیزینس میتواند تصمیمهای دقیقتر بگیرد، نه تصمیمهایی بر پایهی دادهی ناقص یا گمراهکننده.

بنابراین دلایل اصلی که باید دیتا را پیشپردازش کنیم را میتوانیم در زیر فهرست کنیم:

- افزایش کیفیت دیتا

- بهبود عملکرد مدلها

- کاهش پیچیدگی محاسبات

- ایجاد بینشهای قابلاعتماد برای تحلیل و هوش کسبوکار

همین حالا ثبتنام کنید!

چه کتابخانههایی برای پیشپردازش داده در پایتون ضروری هستند؟

کتابخانههای پایتون در آموزش پاکسازی داده با پایتون بسیار مهم هستند و در واقع انجام اکثر مراحل پیشپردازش بدون آنها عملاً ممکن نیست.

| کتابخانه | کاربرد |

|---|---|

| Pandas | تمیز کردن دادهها با پایتون، مدیریت دیتافریمها |

| NumPy | محاسبات عددی و کار با آرایهها |

| Scikit-learn | پیشپردازش داده در پایتون با sklearn |

| Matplotlib / Seaborn | بررسی داده با نمودار پیش از پاکسازی |

برای مثال، preprocessing با Pandas برای حذف دادههای ناقص، اصلاح دادههای پرت و تبدیل نوع دادهها یکی از رایجترین روشها در پروژههای تحلیل داده است.

تفاوت پیشپردازش با تحلیل داده و دادهکاوی چیست؟

در حوزهی مرتبسازی و کار با دیتا، بسیاری از توسعهدهندگان این سه مفهوم پیشپردازش داده، تحلیل داده و دادهکاوی را با یکدیگر اشتباه میگیرند.

- پیشپردازش داده یعنی آمادهسازی و تمیز کردن دیتا.

- تحلیل داده یعنی استخراج الگوها، روابط و بینشها.

- دادهکاوی یک گام جلوتر است و با تمرکز بر کشف الگوهای پنهان و پیشبینی انجام میشود.

مراحل کلی آموزش پیشپردازش داده با پایتون

در بسیاری از پروژهها مراحل پیشپردازش داده شامل موارد زیر است:

۱. پاکسازی داده

پاکسازی داده اولین مرحله پیشپردازش است. در این گام، دادههایی که ناقص، تکراری یا ناهماهنگ هستند شناسایی و اصلاح میشوند. مدیریت مقادیر گمشده، حذف رکوردهای تکراری، تصحیح فرمت دادهها و برطرف کردن ناسازگاریها باعث میشود دیتاست از خطاهای اولیه پاک شود و برای مراحل بعدی آماده گردد.

۲. تبدیل داده

در مرحلهی بعد، وارد تبدیل داده میشویم. این مرحله بیشتر با آمادهسازی داده برای الگوریتمها سروکار دارد. استانداردسازی و نرمالسازی دادههای عددی، کدگذاری دادههای دستهای و انجام مهندسی ویژگی کمک میکند مدلها بتوانند داده را بهتر درک کنند و الگوها را دقیقتر یاد بگیرند.

۳. یکپارچهسازی داده

پس از تبدیل داده، نوبت به یکپارچهسازی داده میرسد. در بسیاری از پروژهها دادهها از چند منبع مختلف جمعآوری میشوند. در این مرحله دیتاستها با هم ادغام میشوند، ساختارها هماهنگ میگردند و دادههای افزونه یا تکراری حذف میشوند تا یک مجموعهدادهی منسجم و یکدست به دست آید.

۴. کاهش داده

در آخرین مرحله کاهش داده انجام میشود. زمانی که حجم داده زیاد یا تعداد ویژگیها بیش از حد باشد، انتخاب ویژگیهای مهم یا کاهش ابعاد با روشهایی مثل PCA باعث کاهش پیچیدگی محاسبات و افزایش کارایی مدل میشود، بدون اینکه اطلاعات اصلی از بین برود.

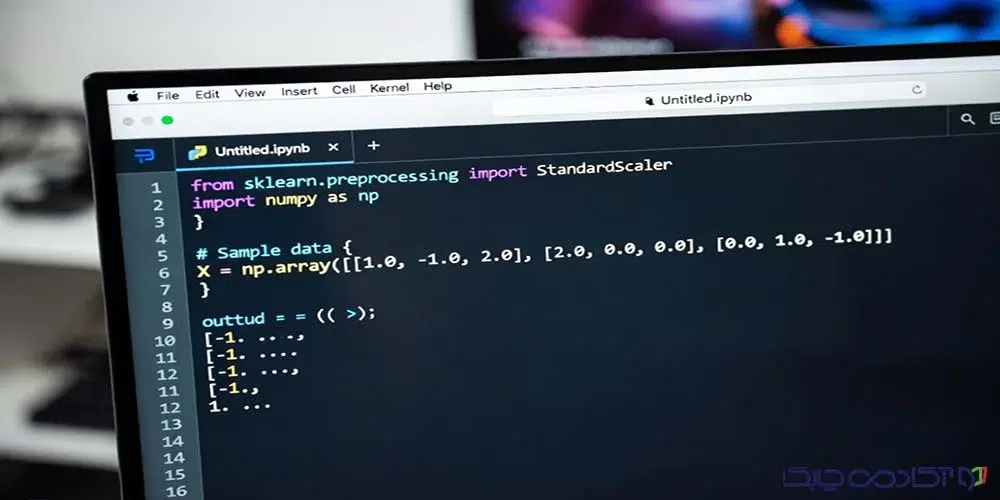

مثال: کد پیشپردازش استاندارد در Python

در بسیاری از پروژههای واقعی، یک Pipeline ساده اما استاندارد به شکل زیر استفاده میشود:

import pandas as pd

from sklearn.preprocessing import StandardScaler

from sklearn.impute import SimpleImputer

# بارگذاری داده

data = pd.read_csv(“data.csv”)

# جداسازی ویژگیهای عددی

numeric_data = data.select_dtypes(include=[“int64”, “float64”])

# مدیریت مقادیر گمشده

imputer = SimpleImputer(strategy=”mean”)

numeric_data_imputed = imputer.fit_transform(numeric_data)

# نرمالسازی دادهها

scaler = StandardScaler()

numeric_data_scaled = scaler.fit_transform(numeric_data_imputed)

print(“دادههای آمادهشده برای مدل:”)

print(numeric_data_scaled[:5])

سخن پایانی

پیشپردازش داده یکی از پایههای اصلی موفقیت در تحلیل داده، هوش مصنوعی و یادگیری ماشین است. ما در این حوزهها بدون داشتن دادهی تمیز و ساختارمند، عملاً شانسی برای رسیدن به نتایج کاربردی نداریم. برای همین است که کیفیت داده، اغلب از خودِ مدلها مهمتر تلقی میشود و بسیاری از چالشهای پروژههای دادهمحور ریشه در آمادهسازی نادرست داده دارند.

اگر میخواهید قدمبهقدم وارد حوزه Data Science شوید و از این مسیر به درآمد واقعی برسید، پیشنهاد میکنیم نگاهی به دورههای ساختارمند آکادمی چابک بیندازید. این دورهها برای تازهواردها، تحلیلگران داده و علاقهمندان جدی یادگیری ماشین طراحی شدهاند و مسیر یادگیری را برای شما شفاف میکنند.

منبع:

دیدگاهتان را بنویسید